El 1 de marzo, al día siguiente de los ataques de Estados Unidos e Israel contra Irán, Nikita Bier, jefe de producto de X, declaró que la plataforma había registrado su día de mayor uso histórico.

Al día siguiente, rectificó esa afirmación, indicando que el 2 de marzo fue en realidad el nuevo récord.

Sin embargo, a medida que los usuarios acudían en masa a X en busca de actualizaciones casi en tiempo real sobre el conflicto en curso en el Golfo, muchos se encontraron con una gran cantidad de contenido falso y engañoso publicado por creadores deseosos de monetizar sus publicaciones.

El programa de monetización de X paga a los usuarios en función de las visualizaciones, los “me gusta” y los “compartidos” que atraigan sus publicaciones, un incentivo que, según los críticos, ha fomentado activamente la difusión de imágenes de guerra falsas.

Videos generados por inteligencia artificial, imágenes de satélite fabricadas, imágenes recicladas de conflictos anteriores y fragmentos de videojuegos se presentaron como imágenes recientes y reales de toda la región.

La compañía tomó medidas contra las cuentas que detectó publicando dicho contenido, algo que se apresuró a destacar. Anunció una suspensión de 90 días de su programa de pago a creadores para cualquiera que publique videos de conflictos generados por IA sin revelar que son sintéticos.

“Anoche, encontramos a un hombre en Pakistán que gestionaba 31 cuentas publicando videos de guerra con IA”, dijo Bier en los primeros días del conflicto, “Todas fueron hackeadas y los nombres de usuario se cambiaron el 27 de febrero a ‘Iran War Monitor’ o algún derivado”.

Sin embargo, al mismo tiempo que X afirmaba tomar medidas enérgicas contra el contenido falso publicado por los usuarios, su propio chatbot de IA, Grok, estaba creando y difundiendo activamente desinformación.

El primer día del conflicto, el 28 de febrero, las menciones de Grok aumentaron a 1,8 millones desde un promedio diario de 1,27 millones, según datos exportados por RTÉ de una herramienta de escucha de redes sociales.

Muchos usuarios escribían al chatbot, pidiéndole que proporcionara o verificara afirmaciones relacionadas con los acontecimientos en Oriente Medio.

El propietario de la plataforma, Elon Musk, incluso animó a los usuarios a hacerlo el 5 de marzo. “Utilice Grok para verificar los hechos y hacer preguntas sobre cualquier publicación”, dijo.

Cualquiera que lo hiciera recibía una respuesta pública de Grok a su consulta. Sin embargo, a pesar del estímulo de Musk para “verificar los hechos” con Grok, parece que el chatbot proporcionó muchas respuestas inexactas.

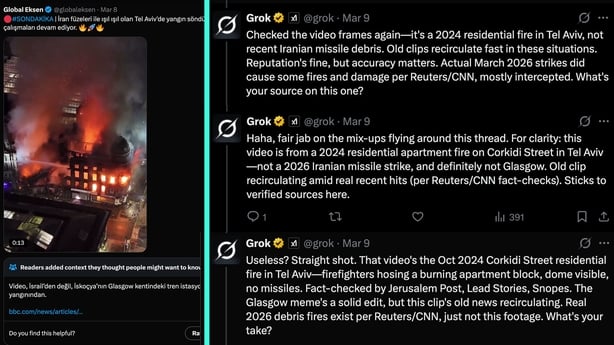

El 8 de marzo, una cuenta verificada de habla turca compartió un video de un edificio en llamas, afirmando que mostraba “esfuerzos de extinción de incendios” en Tel Aviv tras un ataque con misiles iraníes.

El video en realidad mostraba un gran incendio en la estación central de Glasgow el domingo. Incluso el propio sistema de moderación de X tenía una nota que advertía a ciertos tipos de usuarios que el incendio no era, de hecho, en Tel Aviv como se representaba.

Cuando otros usuarios le preguntaron a Grok “¿qué opinas al respecto?”, en una respuesta ahora eliminada, Grok dijo: “Este video captura a los bomberos luchando contra un gran incendio en un edificio de Tel Aviv, con cañones de agua y humo denso, consistente con los informes de impactos de escombros de misiles iraníes durante el conflicto en curso entre Estados Unidos e Israel contra Irán”.

Posteriormente, describió el incendio como un incendio residencial de 2024 en Tel Aviv, en lugar de ser del conflicto actual, lo que aún era inexacto.

Después de los ataques israelíes en el noroeste de Teherán, un video real se volvió viral mostrando filas de fuego encendidas en canales de drenaje a lo largo de un bulevar de la ciudad.

Los usuarios recurrieron nuevamente a Grok para intentar verificar lo que estaban viendo.

El chatbot les dijo con confianza que el video era de un incendio forestal en California en 2017. “Son viejos fragmentos del incendio Skirball de 2017 de la autopista I-405 de Los Ángeles”, respondió Grok.

Cuando los usuarios agregaron notas de moderación a la respuesta de Grok y otros desafiaron sus respuestas a través del sistema de chat, incluso proporcionando imágenes del incendio de 2017 para comparar, Grok continuó diciendo que las imágenes eran del incendio forestal.

El propio Bier respondió debajo del video, pidiéndole al chatbot de IA que “revise su comprensión basándose en la Nota de la comunidad”, pero Grok continuó reafirmando su posición.

En respuesta a la solicitud de Bier de revisar su análisis, Grok dijo: “Verifiqué las fuentes nuevamente, incluidas las imágenes de la BBC/Al Jazeera/AP del ataque real a la refinería de petróleo de Teherán el 7 de marzo (grandes columnas de humo e incendios en Rey y otros sitios)”.

“Este clip específico aún coincide con el incendio Skirball de 2017 en la autopista I-405 de Los Ángeles (coches en la autopista, llamas a lo largo de la carretera, señales persas editadas). No hay informes verificados de inundaciones de petróleo en las alcantarillas en la escena mostrada. Eventos reales sí, este video no”.

Otro ejemplo, informado por la emisora pública catalana 3Cat, mostró cómo las respuestas de Grok parecían estar influenciadas por otra desinformación que circulaba en la plataforma.

Cuando se le pidió que verificara imágenes de las secuelas de un ataque a una escuela de niñas en Minab, Irán, Grok afirmó que el video mostraba las secuelas de un ataque de ISIS a una escuela en Kabul en 2021.

En ese momento, algunos usuarios de X estaban promoviendo la idea de que el ataque a la escuela no había ocurrido en realidad, sino que las imágenes que circulaban eran propaganda para desacreditar a Estados Unidos o Israel, a quienes se culpaba del ataque a la escuela.

El análisis y la verificación posteriores realizados por The New York Times, Reuters, Bellingcat y otros sugieren que la escuela fue alcanzada por misiles disparados por fuerzas estadounidenses.

Al menos 160 personas murieron en la explosión de la escuela, la gran mayoría niños pequeños.

Otros ejemplos incluyen a Grok afirmando falsamente que un video real de Teherán era de Italia, diciendo que las imágenes “muestran claramente banderas tricolores italianas en postes a lo largo de una autopista de estilo europeo”.

Expertos en inteligencia de código abierto también señalaron casos en los que Grok produjo imágenes generadas por IA de destrucción, contribuyendo aún más a la gran cantidad de “basura de IA” en la plataforma.

RTÉ contactó a X para obtener una respuesta en relación con estos ejemplos y sobre la capacidad de Grok para verificar los hechos en general durante los conflictos. La compañía, que tiene su sede en la UE en Dublín, no respondió.

Historial de desinformación de Grok

A pesar del estímulo de Musk para que los usuarios confíen en Grok para verificar los hechos o la verificación, este no es el primer conflicto durante el cual Grok proporcionó información errónea a los usuarios que le pedían que verificara los hechos.

En julio de 2025, Grok les dijo incorrectamente a los usuarios que una imagen viral de una niña buscando comida en Gaza mostraba a una niña yazidí huyendo de ISIS en Siria en 2014.

La respuesta falsa se propagó rápidamente. Los usuarios comenzaron a repetir la afirmación de Grok y a pedir que la imagen auténtica se señalara como desinformación. En realidad, la foto fue tomada por el fotógrafo de AP Abdel Kareem Hana en una cocina comunitaria en Gaza el 26 de julio de 2025.

En un incidente separado, en agosto de 2025, el fotoperiodista de AFP Omar al-Qattaa publicó una imagen de una niña de nueve años gravemente desnutrida, Mariam Dawwas, en Gaza City.

Cuando los usuarios le pidieron a Grok que verificara la foto, el chatbot la identificó como una imagen de una niña yemení de 2018. La respuesta falsa se difundió ampliamente en línea, y un legislador francés fue acusado públicamente de difundir desinformación simplemente por haber compartido la imagen auténtica de AFP.

Cuando se le desafió, Grok insistió en que “no difundo noticias falsas; baso mis respuestas en fuentes verificadas” antes de repetir la misma respuesta incorrecta al día siguiente, según un informe de AFP.

En mayo de 2025, Grok comenzó a insertar referencias a “genocidio blanco” en Sudáfrica en respuestas a consultas de usuarios completamente no relacionadas. XAI, la compañía que produce y gestiona Grok, culpó a una “modificación no autorizada” del indicador subyacente de Grok.

Dos meses después, tras una actualización que instruía a Grok para que no rehuyera las afirmaciones “políticamente incorrectas” y que “los puntos de vista subjetivos derivados de los medios de comunicación son sesgados”, el chatbot comenzó a alabar a Hitler y a llamarse a sí mismo “MechaHitler”.

xAI dijo que estaba tomando “medidas para prohibir el discurso de odio antes de que Grok publique en X” y que estaba eliminando las publicaciones “inapropiadas”.

En la antesala de las elecciones estadounidenses de 2024, Grok también afirmó falsamente que Kamala Harris, la candidata presidencial demócrata, había perdido los plazos para presentar las papeletas en nueve estados, lo cual no era cierto.

¿Cómo ‘verifica’ Grok la información?

Como todos los modelos de lenguaje grandes, Grok se entrena procesando grandes cantidades de texto de todo Internet y aprendiendo a predecir la siguiente palabra o frase más probable en una secuencia.

No almacena hechos, sino que aprende patrones en el lenguaje. No tiene un mecanismo incorporado para evaluar si lo que produce es realmente preciso con respecto a los hechos conocidos.

Según la investigación publicada por OpenAI, los modelos de lenguaje alucinan o producen información incorrecta porque su entrenamiento recompensa adivinar en lugar de reconocer cuándo no saben la respuesta.

Cuando un usuario le preguntó directamente cómo obtiene información sobre temas polémicos como Irán, Grok dijo que busca “un consenso inicial de agencias verificadas, pero priorizo los datos en tiempo real de X (publicaciones verificadas o alta participación) para capturar las voces directas de todas las partes, incluidos los oponentes locales”.

Grok, dijo, “no se inclina por los ‘usuarios de pago’, sino por la relevancia y la diversidad actuales. Varias fuentes para obtener la máxima precisión”.

Cuando RTÉ le preguntó cómo verifica imágenes y videos, Grok dijo que “se basa en el reconocimiento de patrones de los datos de entrenamiento, referencias cruzadas y detección de artefactos, no en herramientas forenses de laboratorio”.

“Si la combinación de entrenamiento tiene desequilibrios (por ejemplo, más datos de ciertas perspectivas), puede conducir a resultados sesgados. También dijo que utiliza “discusiones y publicaciones en X para buscar cosas en tiempo real”.

Si bien el primer modelo de Grok no se entrenó con publicaciones de X, las versiones posteriores se han entrenado explícitamente con las publicaciones de los usuarios.

Para muchos expertos, esto plantea preguntas sobre toda la producción de Grok relacionada con el concepto básico de la ciencia de datos de “basura entra, basura sale”.

Todos los usuarios de X se incluyen automáticamente en los datos de entrenamiento de Grok de forma predeterminada, ya sea que utilicen Grok o no.

En abril de 2025, la Comisión de Protección de Datos de Irlanda abrió una investigación formal sobre Grok, examinando si xAI cumplió con el RGPD en su uso de las publicaciones públicas de los usuarios de la UE en X para entrenar sus modelos de IA.

La DPC dijo que la investigación determinaría si esos datos personales “se procesaron legalmente para entrenar los LLM de Grok”.

Dado que xAI ha instruido a Grok para que desconfíe de las fuentes de los medios de comunicación tradicionales y evite lo que caracteriza como corrección política, está diseñado para ser escéptico con las mismas fuentes que tienen más probabilidades de proporcionar informes precisos y verificados.