Por Glynn Wilson –

Crónicas Desde la Carretera MoJo –

SAN FRANCISCO, California – Íbamos por las cercanías de Sunnyvale, rumbo al norte a gran velocidad por la Interestatal 101, cuando el sol finalmente atravesó la niebla justo a tiempo para revelar la vista de South Bay. El efecto del caramelo de sativa comenzaba a notarse mientras expulsaba el cassette y buscaba en la radio. Se detuvo justo cuando el London Bach Choir comenzaba a cantar: “You can’t always get what you want” (No siempre puedes obtener lo que quieres).

Entonces, los Rolling Stones entraron con: “But if you try sometimes, you just might get what you need” (Pero si lo intentas a veces, podrías obtener lo que necesitas).

La historia de mi vida.

Como se prometió, en la emisión original de “Good Morning Coulterville! Premiere Broadcast (¡Buenos días Coulterville! Emisión de estreno)” en Yosemite Radio, ahora hablaremos sobre la ciencia evolutiva del altruismo frente al gen egoísta. En este lugar, donde el movimiento hacia el “altruismo efectivo” ha echado raíces, junto a su gemelo malvado, el “narcisismo egoísta”.

Cuando el ganador en esta lucha fundamental de la humanidad se revele, sabremos si hay un futuro para algún vestigio del “Sueño Americano” de la democracia, o si todo terminó hace mucho tiempo y el final era inevitable, como Hunter Thompson intentó advertirnos, como el Imperio Romano y todos los demás imperios que duraron unos 250 años.

Si Nixon no fue lo suficientemente malo como para destruirlo, junto con un par de Bush, el Golden Flake Trump y sus amigos Elon Musk y Mark Zuckerberg están intentándolo, todo en nombre de tratar de hacer que Estados Unidos sea “grande de nuevo” y el mundo “conectado”, como dijo Zuckerberg después de prometer “movernos rápido y romper cosas”.

La investigación muestra que todo lo que hicieron las redes sociales fue hacernos sentir menos conectados y más divididos que nunca. Pero sí rompieron cosas, incluida la democracia estadounidense. Ahora, Zuck quiere “llevar una superinteligencia artificial personal a todos”, quieran o no.

Nadie por aquí pensó que Estados Unidos era algo más que grande todo el tiempo, y eso incluiría a Steve Jobs, Steve Wozniak y Tim Cook de Baldwin County, Alabama, ahora el jefe de Apple.

¿De qué están hablando estos inadaptados y estudiantes universitarios que ahora quieren controlar todos los aspectos de nuestras vidas?

Si se hubieran molestado en asistir a una clase o leer un libro sobre la ciencia de la evolución, la filosofía o incluso la ética empresarial, podrían haber hecho grandes cosas por Estados Unidos y el planeta. En cambio, nos están llevando a todos a un abismo oscuro al final de todas las cosas, como la “nada” en la “Historia sin Fin” de Fantasía.

¡BASTA!

¿Cuántos miles de millones y billones necesitan para ser felices, hombres? ¿Alguna vez será suficiente?

Por favor, renuncien, jubílens y donen todo su dinero como Bill Gates y Warren Buffett. Vayan a jugar a su búnker subterráneo secreto en la playa de arena volcánica negra de Hawái. Ya han hecho suficiente daño.

Mientras contemplaba esta gran ciudad con vistas y pensaba en cómo comunicar cuáles son los problemas y cómo resolverlos, la musa me llevó de vuelta al problema básico sobre el que he estado escribiendo durante años. Cómo contrarrestar el gen egoísta, ahora potenciado con esteroides, inundando el mundo de altruismo.

Si hacen una búsqueda en The New American Journal de “altruismo”, verán 53 artículos, siendo el más destacado este:

Pero mientras investigaba más y pensaba en cómo abordar este problema, me encontré con un grupo que se ha dedicado a promover el “Altruismo Efectivo”.

Uno de los creadores de este movimiento es el filósofo escocés Will MacAskill, no un estudiante universitario que abandona sus estudios. Fue investigador en el Global Priorities Institute de la Universidad de Oxford y cofundó un grupo filantrópico llamado Giving What We Can y publicó un libro en 2015 llamado “Doing Good Better” (Hacer el bien mejor). Enseñó a nivel universitario durante 10 años, como yo. En 2020 fue coautor de “Moral Uncertainty” (Incertidumbre moral) y en 2022 publicó “What We Owe the Future” (Lo que le debemos al futuro).

Comenzó a ganar fama con charlas TED en YouTube, como esta del 3 de octubre de 2018.

What are the most important moral problems of our time? (¿Cuáles son los problemas morales más importantes de nuestro tiempo?)

Of all the problems facing humanity, which should we focus on solving first? In a compelling talk about how to make the world better, moral philosopher Will MacAskill provides a framework for answering this question based on the philosophy of “effective altruism” — and shares ideas for taking on three pressing global issues.

En una conferencia en San Francisco ese mismo año, dio otra sobre “Why should effective altruists embrace uncertainty?” (¿Por qué los altruistas efectivos deberían aceptar la incertidumbre?).

Probabilistic thinking is only a few centuries old, we have very little understanding on how most of our actions affect the long-term future, and prominent members of the effective altruism community have changed their minds on crucial considerations before. These are just three of the reasons that Will MacAskill urges effective altruists to embrace uncertainty, and not become too attached to present views. This talk was the closing talk for EA Global: San Francisco 2018.

También ha aparecido en algunos programas de entrevistas de televisión, incluido The Daily Show.

El grupo, con sede en el Reino Unido, tiene un sitio web donde se explican la misión y los objetivos, comenzando con este ensayo.

What is effective altruism? (¿Qué es el altruismo efectivo?)

Effective altruism is a project that aims to find the best ways to help others, and put them into practice.

It’s both a research field, which aims to identify the world’s most pressing problems and the best solutions to them, and a practical community that aims to use those findings to do good.

This project matters because, while many attempts to do good fail, some are enormously effective. For instance, some charities help 100 or even 1,000 times as many people as others, when given the same amount of resources.

This means that by thinking carefully about the best ways to help, we can do far more to tackle the world’s biggest problems.

Effective altruism was formalized by scholars at Oxford University, but has now spread around the world, and is being applied by tens of thousands of people in more than 70 countries.

People inspired by effective altruism have worked on projects that range from funding the distribution of 200 million malaria nets, to academic research on the future of A.I., to campaigning for policies to prevent the next pandemic.

They’re not united by any particular solution to the world’s problems, but by a way of thinking. They try to find unusually good ways of helping, so that a given amount of effort goes an unusually long way.

Han identificado algunos de los problemas más grandes a abordar, incluida la proliferación nuclear, los bioamenazas que podrían causar la próxima pandemia, el suministro de suministros médicos en países pobres y la defensa de la abolición de la agricultura industrial. Pero el que quiero enfocar es qué hacer con las crecientes amenazas de la Inteligencia Artificial.

Lo que este grupo quiere hacer es ayudar a crear un campo de investigación de alineación de la IA.

“La inteligencia artificial (IA) está progresando rápidamente. Los principales sistemas de IA ahora son capaces de mantener una conversación limitada, resolver problemas de matemáticas de nivel universitario, explicar chistes, generar imágenes extremadamente realistas a partir de texto y realizar una codificación básica. Nada de esto era posible hace solo diez años. El objetivo final de los principales laboratorios de IA es desarrollar una IA que sea tan buena como, o mejor que, los humanos en todas las tareas.

“Es extremadamente difícil predecir el futuro de la tecnología, pero varios argumentos y encuestas de expertos sugieren que este logro es más probable que no en este siglo. Y, según los modelos económicos estándar, una vez que la IA general puede funcionar a nivel humano, el progreso tecnológico podría acelerarse drásticamente. El resultado sería una transformación enorme, quizás de una importancia similar o mayor que la revolución industrial del siglo XIX.

“Si se maneja bien”, dicen, “esta transformación podría traer abundancia y prosperidad para todos. Si se maneja mal, podría resultar en una concentración extrema de poder en manos de una pequeña élite”.

Eso parece ser la tendencia.

“En el peor de los casos, podríamos perder el control de los propios sistemas de IA. Incapaces de gobernar a seres con capacidades muy superiores a las nuestras, nos encontraríamos con tan poco control sobre nuestro futuro como los chimpancés sobre el suyo”.

“Esto significa que este problema podría tener un impacto dramático no solo en la generación actual, sino también en todas las generaciones futuras”.

Esto lo hace especialmente urgente desde una perspectiva “a largo plazo”, una escuela de pensamiento que sostiene que mejorar el futuro a largo plazo es una prioridad moral clave de nuestro tiempo.

“Cómo asegurar que los sistemas de IA continúen promoviendo los valores humanos, incluso a medida que se vuelven iguales (o superiores) a los humanos en sus capacidades, se llama el problema de la alineación de la IA, y resolverlo requiere avances en la informática. A pesar de su potencial importancia histórica, solo un par de cientos de investigadores trabajan en este problema, en comparación con decenas de miles que trabajan para hacer que los sistemas de IA sean más potentes”.

“Una prioridad es simplemente informar a más personas sobre el problema”, dicen, así que estamos haciendo eso aquí mismo.

El libro “Superintelligence” se publicó en 2014, argumentando la importancia de la alineación de la IA. Se convirtió en un éxito de ventas del New York Times.

Otra prioridad es construir un campo de investigación centrado en este problema.

El pionero de la IA Stuart Russell, y otros inspirados en el altruismo efectivo, fundaron el Centro para la IA Compatible con el Humano en la Universidad de California, Berkeley. Este instituto de investigación tiene como objetivo desarrollar un nuevo paradigma de desarrollo de la IA, “en el que el acto de promover los valores humanos sea central”.

Otros han ayudado a iniciar equipos centrados en la alineación de la IA en los principales laboratorios de IA como DeepMind y OpenAI, y a delinear agendas de investigación para la alineación de la IA, en obras como Concrete Problems in A.I. Safety (Problemas concretos en la seguridad de la IA).

Medios rotos

Ahora estamos involucrados en este tema, y como hemos estado diciendo todo el tiempo, una gran parte del problema es nuestro sistema de comunicación de noticias y redes sociales roto, y nuestro sistema político, que debe solucionarse antes de que se puedan resolver estos otros problemas a largo plazo. Nadie más parece estar haciendo las preguntas correctas.

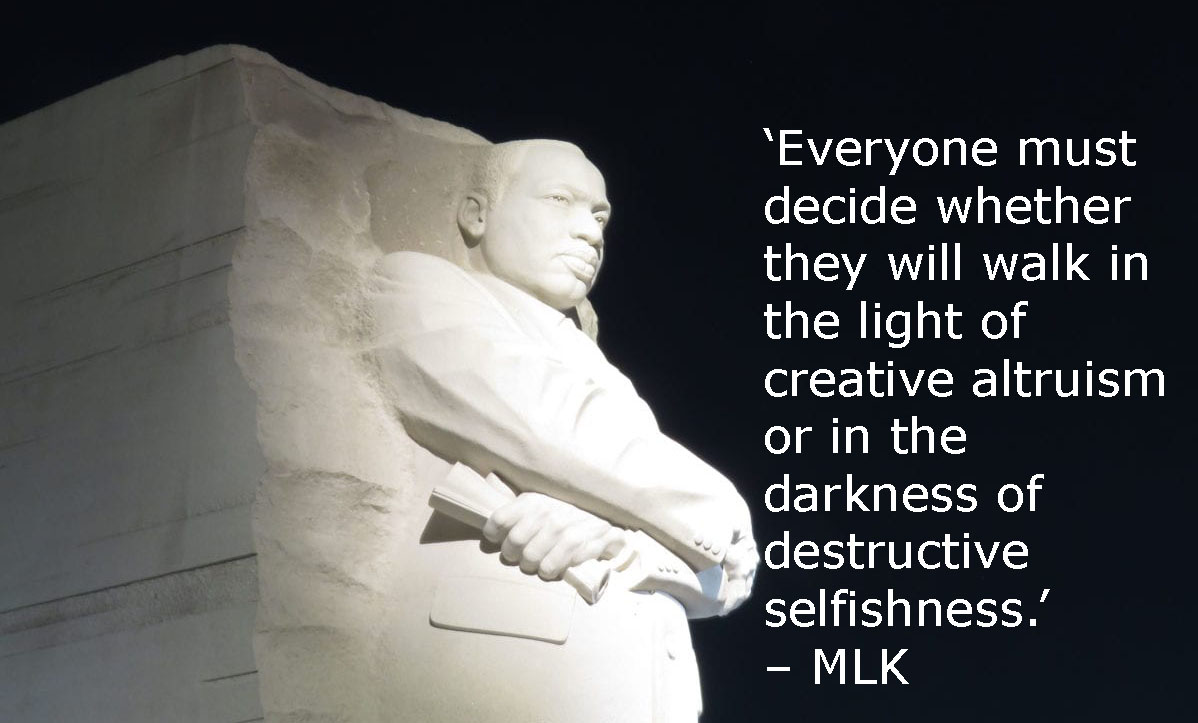

Incluso Martin Luther King Jr., un hombre inteligente y bien leído en su época, sabía que el altruismo era la respuesta.

Si apoya el periodismo veraz sin un muro de pago y la escritura valiente sin anuncios emergentes ni contenido patrocinado, considere hacer una contribución hoy con GoFundMe o Patreon o PayPal.